Μερικοί ασθενείς ανακάλυψαν ότι οι ιδιωτικές τους εξομολογήσεις τροφοδοτούνται σιωπηλά σε τεχνητή νοημοσύνη.

Μερικοί ασθενείς ανακάλυψαν ότι οι ιδιωτικές τους εξομολογήσεις τροφοδοτούνται σιωπηλά σε τεχνητή νοημοσύνη.

Η εικόνα μοιάζει βγαλμένη από μια δυστοπική σάτιρα της Σίλικον Βάλεϊ, εκεί όπου τα μοντέλα τεχνητής νοημοσύνης παρουσιάζονται ως τόσο συμπονετικά και ευφυή που υπόσχονται να αντικαταστήσουν τους θεραπευτές. Στον φαντασιακό αυτό κόσμο οι αλγόριθμοι θα πρόσφεραν απεριόριστη ψυχολογική φροντίδα σε εκατομμύρια ανθρώπους, χωρίς να χρειάζονται πτυχία, άδειες άσκησης επαγγέλματος ή για να το πούμε πιο ανθρώπινα ώρες ύπνου. Στην πραγματικότητα όμως, το τοπίο που ξεδιπλώνεται είναι πολύ διαφορετικό.

Πρόσφατα αποκαλύφθηκε ότι ορισμένοι θεραπευτές χρησιμοποιούν κρυφά το ChatGPT κατά τη διάρκεια συνεδριών με ασθενείς τους. Σε κάποιες περιπτώσεις μάλιστα η αποκάλυψη έγινε τυχαία: ένας θεραπευτής μοιράστηκε κατά λάθος την οθόνη του σε διαδικτυακή συνεδρία και ο ασθενής είδε τις δικές του εξομολογήσεις να μετατρέπονται σε εισαγωγές σε ένα chatbot, με τις απαντήσεις να επιστρέφουν έτοιμες και να αναπαράγονται από τον ίδιο τον θεραπευτή. Η σκηνή που μοιάζει με κωμωδία άφησε πίσω της κάτι πολύ σοβαρότερο: το ρήγμα εμπιστοσύνης στον πιο ευαίσθητο χώρο, εκεί όπου η ειλικρίνεια και η διαφάνεια αποτελούν θεμέλια.

Η είδηση αυτή ανέδειξε ένα ζήτημα που μέχρι τώρα κρυβόταν στη σκιά. Η χρήση εργαλείων τεχνητής νοημοσύνης στην ψυχοθεραπεία δεν είναι εξ ορισμού απαγορευτική, ούτε στερείται προοπτικών. Κλινικές μελέτες έχουν δείξει ότι εξειδικευμένα AI μοντέλα, σχεδιασμένα για συγκεκριμένες θεραπευτικές μεθόδους όπως η Γνωσιακή Συμπεριφορική Θεραπεία (CBT) μπορούν να προσφέρουν δομημένη και αποτελεσματική υποστήριξη. Όμως άλλο πράγμα ένα εργαλείο ειδικά φτιαγμένο για να ακολουθεί αυστηρά θεραπευτικά πρωτόκολλα και άλλο η χρήση ενός γενικού chatbot που δεν έχει καμία πιστοποίηση ή ηθική δέσμευση.

Οι αντιδράσεις των ασθενών ήταν εύλογες. Η αποκάλυψη της κρυφής μεσολάβησης της τεχνητής νοημοσύνης προκάλεσε αμηχανία, αίσθημα προδοσίας και ερωτήματα για το κατά πόσο οι προσωπικές τους εξομολογήσεις προστατεύονται. Σε ένα επάγγελμα που βασίζεται στην απόλυτη εμπιστοσύνη και στην αίσθηση ότι ο θεραπευτής βρίσκεται εκεί “παρών” και αφοσιωμένος, η χρήση του ChatGPT χωρίς συναίνεση μοιάζει με ρήγμα που δύσκολα επουλώνεται. Δεν είναι τυχαίο ότι αρκετοί ειδικοί επισημαίνουν πως το ελάχιστο που οφείλει ένας θεραπευτής είναι να ενημερώνει εκ των προτέρων τον ασθενή για οποιαδήποτε χρήση τέτοιων εργαλείων. Η διαφάνεια δεν είναι πολυτέλεια. Eίναι η προϋπόθεση για να μη χαθεί η σχέση εμπιστοσύνης.

Βέβαια δεν λείπουν εκείνοι που βλέπουν στην AI μια πιθανή “σανίδα σωτηρίας”. Οι σημειώσεις, η γραφειοκρατία, η ανάγκη καταγραφής περιστατικών θεωρούνται συχνά από τους θεραπευτές το πιο κουραστικό κομμάτι της δουλειάς τους. Ένα εργαλείο που θα μπορούσε να διευκολύνει αυτή τη διαδικασία φαντάζει δελεαστικό, ωστόσο η διάκριση ανάμεσα στη διαχείριση σημειώσεων και στη διαχείριση της ίδιας της θεραπευτικής πράξης είναι κρίσιμη. Το πρώτο μπορεί να είναι μια ουδέτερη διευκόλυνση. Το δεύτερο ακουμπά στον πυρήνα της επαγγελματικής ευθύνης.

Δεν είναι τυχαίο ότι επαγγελματικοί φορείς όπως η American Counseling Association προειδοποιούν ήδη κατά της χρήσης γενικών AI εργαλείων για διάγνωση ή θεραπευτική καθοδήγηση. Σε ορισμένες πολιτείες των ΗΠΑ έχουν θεσπιστεί νόμοι που απαγορεύουν ρητά τη χρήση AI στη λήψη θεραπευτικών αποφάσεων. Παράλληλα η δημόσια συζήτηση εντείνεται με πολλούς να υπογραμμίζουν ότι η τεχνολογία μπορεί να λειτουργήσει υποστηρικτικά, όχι όμως ως υποκατάστατο της ανθρώπινης σχέσης που βρίσκεται στον πυρήνα της ψυχοθεραπείας.

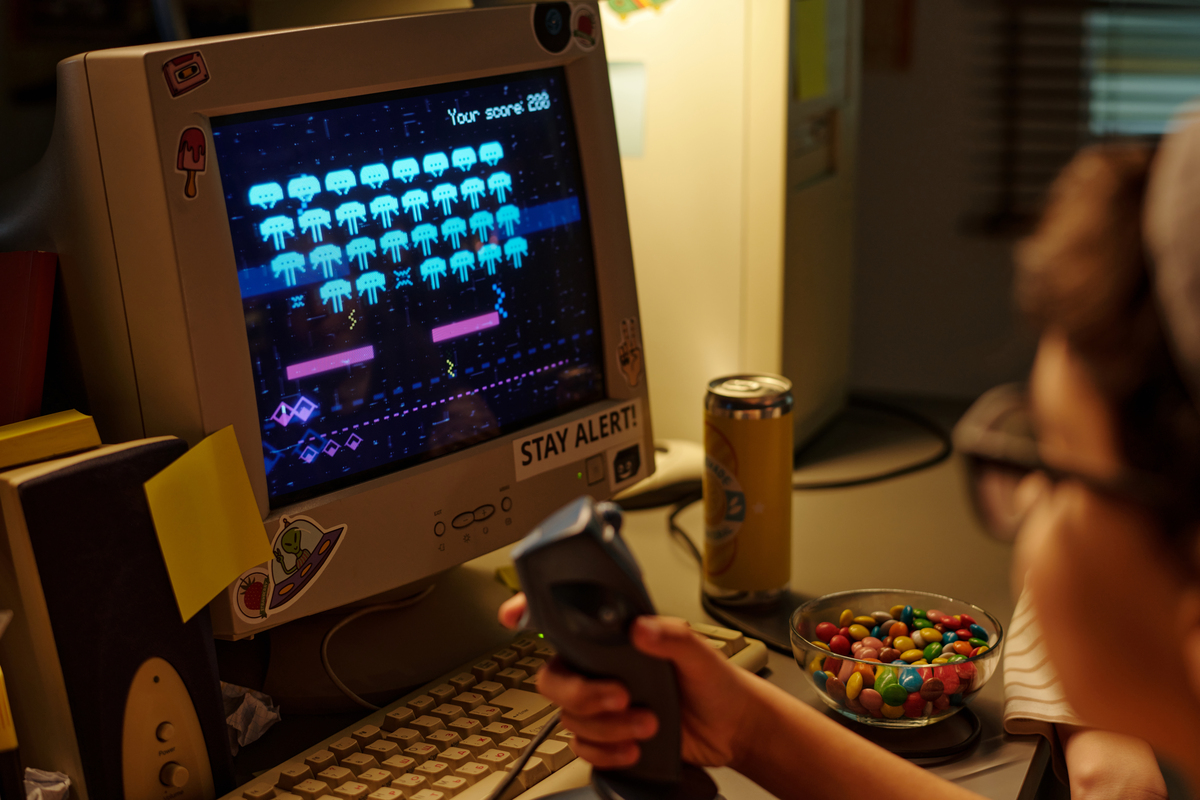

Την ίδια στιγμή, στελέχη τεχνολογικών κολοσσών όπως ο Σαμ Άλτμαν της OpenAI ενθαρρύνουν σιωπηρά τη χρήση του ChatGPT σαν “θεραπευτή τσέπης”. Δεν κρύβουν την ικανοποίησή τους που οι άνθρωποι στρέφονται στα εργαλεία τους για συναισθηματική στήριξη, καθώς αυτό δημιουργεί δεσμούς με τα προϊόντα. Εδώ όμως προκύπτει το ουσιώδες ζήτημα: ό,τι κι αν προσφέρει ένα chatbot δεν μπορεί να αντικαταστήσει την ουσία της θεραπείας. Η πραγματική συνεδρία δεν είναι ποτέ απλώς μια ευχάριστη κουβέντα ή μια ατέρμονη επικύρωση των όσων λέει ο ασθενής. Είναι συχνά επώδυνη, γεμάτη προκλήσεις, με στιγμές που σε φέρνουν αντιμέτωπο με τις πιο σκοτεινές σου πλευρές. Ο θεραπευτής βρίσκεται εκεί για να σε ταράξει, να σε αναμετρήσει με τον εαυτό σου, να σε βοηθήσει να βγεις από τον φαύλο κύκλο. Το ChatGPT αντίθετα, μένει εγκλωβισμένο σε έναν ρόλο καλοπροαίρετου συνομιλητή που δεν ξέρει πώς να αντισταθεί ούτε πως να σπρώξει πέρα από το προφανές.

Η συζήτηση αυτή δεν αφορά μόνο τη θεραπεία. Αγγίζει τον τρόπο που αντιλαμβανόμαστε τη σχέση μας με την τεχνολογία σε πιο βαθύ επίπεδο. Εάν ακόμη και στο πιο ευαίσθητο πεδίο, εκεί όπου αποκαλύπτονται οι πιο ιδιωτικές μας σκέψεις η τεχνητή νοημοσύνη εισβάλλει χωρίς συναίνεση, τότε το ερώτημα δεν είναι απλώς τεχνικό. Είναι πολιτισμικό και ηθικό. Μπορούμε να επιτρέψουμε σε εργαλεία που φτιάχτηκαν για να προβλέπουν λέξεις να εισχωρήσουν στον χώρο όπου η ανθρώπινη εμπιστοσύνη είναι το παν;

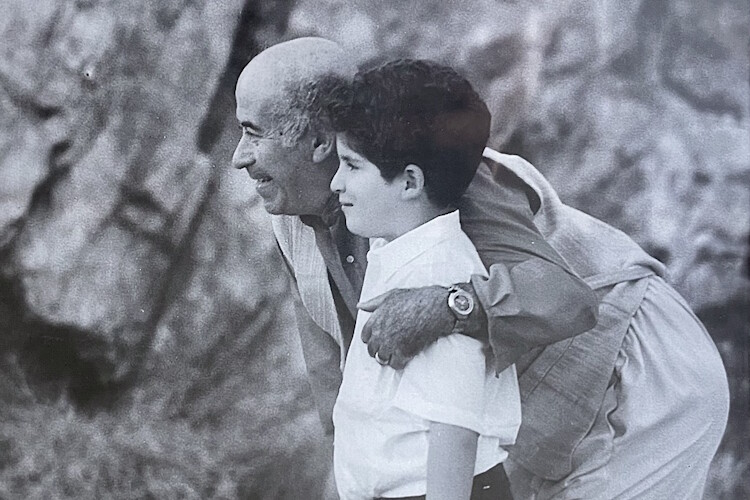

Σε μια εποχή όπου η τεχνητή νοημοσύνη υπόσχεται να γίνει ο αόρατος σύμβουλος, ο ακούραστος συνεργάτης, ακόμη και ο “φίλος” ή “θεραπευτής”, το παράδειγμα αυτό δείχνει τα όρια. Η πρόοδος της τεχνολογίας μπορεί να ανοίγει νέους δρόμους, αλλά ταυτόχρονα μας καλεί να επαναδιατυπώσουμε κανόνες, να θέσουμε όρια και να υπερασπιστούμε θεμελιώδεις αξίες, γιατί η σχέση θεραπευτή–ασθενή δεν είναι απλώς μια ανταλλαγή πληροφοριών. Αποτελεί μια σχέση εμπιστοσύνης, ευαλωτότητας και αυθεντικής παρουσίας κι αυτά όσο εξελιγμένο κι αν είναι, κανένα ChatGPT δεν μπορεί να τα προσφέρει.

Η συζήτηση δεν είναι αν η τεχνητή νοημοσύνη μπορεί να βοηθήσει. Είναι για το πως, πότε και κυρίως με ποια όρια μπορεί να το κάνει. Μέχρι να υπάρξει σαφής απάντηση, οι αποκαλύψεις για θεραπευτές που χρησιμοποιούν κρυφά το ChatGPT θα συνεχίσουν να σοκάρουν, θυμίζοντας πως ακόμη και στην εποχή της μηχανικής νοημοσύνης, η πιο πολύτιμη αξία παραμένει η ανθρώπινη εμπιστοσύνη.

*με στοιχεία από το Technology Review

Μερικοί ασθενείς ανακάλυψαν ότι οι ιδιωτικές τους εξομολογήσεις τροφοδοτούνται σιωπηλά σε τεχνητή νοημοσύνη.

Η εικόνα μοιάζει βγαλμένη από μια δυστοπική σάτιρα της Σίλικον Βάλεϊ, εκεί όπου τα μοντέλα τεχνητής νοημοσύνης παρουσιάζονται ως τόσο συμπονετικά και ευφυή που υπόσχονται να αντικαταστήσουν τους θεραπευτές. Στον φαντασιακό αυτό κόσμο οι αλγόριθμοι θα πρόσφεραν απεριόριστη ψυχολογική φροντίδα σε εκατομμύρια ανθρώπους, χωρίς να χρειάζονται πτυχία, άδειες άσκησης επαγγέλματος ή για να το πούμε πιο ανθρώπινα ώρες ύπνου. Στην πραγματικότητα όμως, το τοπίο που ξεδιπλώνεται είναι πολύ διαφορετικό.

Πρόσφατα αποκαλύφθηκε ότι ορισμένοι θεραπευτές χρησιμοποιούν κρυφά το ChatGPT κατά τη διάρκεια συνεδριών με ασθενείς τους. Σε κάποιες περιπτώσεις μάλιστα η αποκάλυψη έγινε τυχαία: ένας θεραπευτής μοιράστηκε κατά λάθος την οθόνη του σε διαδικτυακή συνεδρία και ο ασθενής είδε τις δικές του εξομολογήσεις να μετατρέπονται σε εισαγωγές σε ένα chatbot, με τις απαντήσεις να επιστρέφουν έτοιμες και να αναπαράγονται από τον ίδιο τον θεραπευτή. Η σκηνή που μοιάζει με κωμωδία άφησε πίσω της κάτι πολύ σοβαρότερο: το ρήγμα εμπιστοσύνης στον πιο ευαίσθητο χώρο, εκεί όπου η ειλικρίνεια και η διαφάνεια αποτελούν θεμέλια.

Η είδηση αυτή ανέδειξε ένα ζήτημα που μέχρι τώρα κρυβόταν στη σκιά. Η χρήση εργαλείων τεχνητής νοημοσύνης στην ψυχοθεραπεία δεν είναι εξ ορισμού απαγορευτική, ούτε στερείται προοπτικών. Κλινικές μελέτες έχουν δείξει ότι εξειδικευμένα AI μοντέλα, σχεδιασμένα για συγκεκριμένες θεραπευτικές μεθόδους όπως η Γνωσιακή Συμπεριφορική Θεραπεία (CBT) μπορούν να προσφέρουν δομημένη και αποτελεσματική υποστήριξη. Όμως άλλο πράγμα ένα εργαλείο ειδικά φτιαγμένο για να ακολουθεί αυστηρά θεραπευτικά πρωτόκολλα και άλλο η χρήση ενός γενικού chatbot που δεν έχει καμία πιστοποίηση ή ηθική δέσμευση.

Οι αντιδράσεις των ασθενών ήταν εύλογες. Η αποκάλυψη της κρυφής μεσολάβησης της τεχνητής νοημοσύνης προκάλεσε αμηχανία, αίσθημα προδοσίας και ερωτήματα για το κατά πόσο οι προσωπικές τους εξομολογήσεις προστατεύονται. Σε ένα επάγγελμα που βασίζεται στην απόλυτη εμπιστοσύνη και στην αίσθηση ότι ο θεραπευτής βρίσκεται εκεί “παρών” και αφοσιωμένος, η χρήση του ChatGPT χωρίς συναίνεση μοιάζει με ρήγμα που δύσκολα επουλώνεται. Δεν είναι τυχαίο ότι αρκετοί ειδικοί επισημαίνουν πως το ελάχιστο που οφείλει ένας θεραπευτής είναι να ενημερώνει εκ των προτέρων τον ασθενή για οποιαδήποτε χρήση τέτοιων εργαλείων. Η διαφάνεια δεν είναι πολυτέλεια. Eίναι η προϋπόθεση για να μη χαθεί η σχέση εμπιστοσύνης.

Βέβαια δεν λείπουν εκείνοι που βλέπουν στην AI μια πιθανή “σανίδα σωτηρίας”. Οι σημειώσεις, η γραφειοκρατία, η ανάγκη καταγραφής περιστατικών θεωρούνται συχνά από τους θεραπευτές το πιο κουραστικό κομμάτι της δουλειάς τους. Ένα εργαλείο που θα μπορούσε να διευκολύνει αυτή τη διαδικασία φαντάζει δελεαστικό, ωστόσο η διάκριση ανάμεσα στη διαχείριση σημειώσεων και στη διαχείριση της ίδιας της θεραπευτικής πράξης είναι κρίσιμη. Το πρώτο μπορεί να είναι μια ουδέτερη διευκόλυνση. Το δεύτερο ακουμπά στον πυρήνα της επαγγελματικής ευθύνης.

Δεν είναι τυχαίο ότι επαγγελματικοί φορείς όπως η American Counseling Association προειδοποιούν ήδη κατά της χρήσης γενικών AI εργαλείων για διάγνωση ή θεραπευτική καθοδήγηση. Σε ορισμένες πολιτείες των ΗΠΑ έχουν θεσπιστεί νόμοι που απαγορεύουν ρητά τη χρήση AI στη λήψη θεραπευτικών αποφάσεων. Παράλληλα η δημόσια συζήτηση εντείνεται με πολλούς να υπογραμμίζουν ότι η τεχνολογία μπορεί να λειτουργήσει υποστηρικτικά, όχι όμως ως υποκατάστατο της ανθρώπινης σχέσης που βρίσκεται στον πυρήνα της ψυχοθεραπείας.

Την ίδια στιγμή, στελέχη τεχνολογικών κολοσσών όπως ο Σαμ Άλτμαν της OpenAI ενθαρρύνουν σιωπηρά τη χρήση του ChatGPT σαν “θεραπευτή τσέπης”. Δεν κρύβουν την ικανοποίησή τους που οι άνθρωποι στρέφονται στα εργαλεία τους για συναισθηματική στήριξη, καθώς αυτό δημιουργεί δεσμούς με τα προϊόντα. Εδώ όμως προκύπτει το ουσιώδες ζήτημα: ό,τι κι αν προσφέρει ένα chatbot δεν μπορεί να αντικαταστήσει την ουσία της θεραπείας. Η πραγματική συνεδρία δεν είναι ποτέ απλώς μια ευχάριστη κουβέντα ή μια ατέρμονη επικύρωση των όσων λέει ο ασθενής. Είναι συχνά επώδυνη, γεμάτη προκλήσεις, με στιγμές που σε φέρνουν αντιμέτωπο με τις πιο σκοτεινές σου πλευρές. Ο θεραπευτής βρίσκεται εκεί για να σε ταράξει, να σε αναμετρήσει με τον εαυτό σου, να σε βοηθήσει να βγεις από τον φαύλο κύκλο. Το ChatGPT αντίθετα, μένει εγκλωβισμένο σε έναν ρόλο καλοπροαίρετου συνομιλητή που δεν ξέρει πώς να αντισταθεί ούτε πως να σπρώξει πέρα από το προφανές.

Η συζήτηση αυτή δεν αφορά μόνο τη θεραπεία. Αγγίζει τον τρόπο που αντιλαμβανόμαστε τη σχέση μας με την τεχνολογία σε πιο βαθύ επίπεδο. Εάν ακόμη και στο πιο ευαίσθητο πεδίο, εκεί όπου αποκαλύπτονται οι πιο ιδιωτικές μας σκέψεις η τεχνητή νοημοσύνη εισβάλλει χωρίς συναίνεση, τότε το ερώτημα δεν είναι απλώς τεχνικό. Είναι πολιτισμικό και ηθικό. Μπορούμε να επιτρέψουμε σε εργαλεία που φτιάχτηκαν για να προβλέπουν λέξεις να εισχωρήσουν στον χώρο όπου η ανθρώπινη εμπιστοσύνη είναι το παν;

Σε μια εποχή όπου η τεχνητή νοημοσύνη υπόσχεται να γίνει ο αόρατος σύμβουλος, ο ακούραστος συνεργάτης, ακόμη και ο “φίλος” ή “θεραπευτής”, το παράδειγμα αυτό δείχνει τα όρια. Η πρόοδος της τεχνολογίας μπορεί να ανοίγει νέους δρόμους, αλλά ταυτόχρονα μας καλεί να επαναδιατυπώσουμε κανόνες, να θέσουμε όρια και να υπερασπιστούμε θεμελιώδεις αξίες, γιατί η σχέση θεραπευτή–ασθενή δεν είναι απλώς μια ανταλλαγή πληροφοριών. Αποτελεί μια σχέση εμπιστοσύνης, ευαλωτότητας και αυθεντικής παρουσίας κι αυτά όσο εξελιγμένο κι αν είναι, κανένα ChatGPT δεν μπορεί να τα προσφέρει.

Η συζήτηση δεν είναι αν η τεχνητή νοημοσύνη μπορεί να βοηθήσει. Είναι για το πως, πότε και κυρίως με ποια όρια μπορεί να το κάνει. Μέχρι να υπάρξει σαφής απάντηση, οι αποκαλύψεις για θεραπευτές που χρησιμοποιούν κρυφά το ChatGPT θα συνεχίσουν να σοκάρουν, θυμίζοντας πως ακόμη και στην εποχή της μηχανικής νοημοσύνης, η πιο πολύτιμη αξία παραμένει η ανθρώπινη εμπιστοσύνη.

*με στοιχεία από το Technology Review